Problemy z indeksowaniem strony

Najprostszy sposób na sprawdzenie czy nasza strona jest indeksowana przez roboty sieciowe to wpisanie w wyszukiwarki (Google, Bing) polecenia site:mojastrona.pl lub skorzystanie z darmowego i prostego dodatku do przeglądarki internetowej SEO Quake. Jeżeli ukaże się lista z wynikami zawierającymi odnośniki do naszych stron, oznacza to, że strona jest indeksowana. Liczba wyników nie zawsze zgadza się z aktualną liczbą naszych podstron. Oto kilka powodów:

- liczba podawanych wyników jest wartością szacunkową

- roboty sieciowe Google i Bing same wybierają strony, które wg nich są wartościowe i umieszczają je w indeksie – można podnieść wartość strony linkując do nich wewnętrznie lub zewnętrznie

- po pewnym czasie, gdy strona przestaje być odwiedzana i traci na popularności, np. zawiera nieaktualne wiadomości, robot sieciowy usuwa ją z indeksu – linki przychodzące pomagają temu zapobiec

Jeżeli jednak liczba stron zaindeksowanych podana w wynikach wyszukiwania znacząco odbiega od ich rzeczywistej ilości na naszej witrynie możliwe, że mamy problem z ich indeksowaniem.

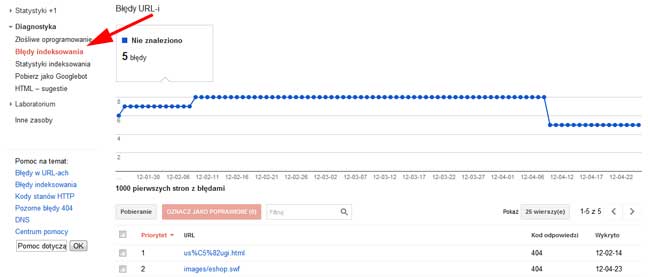

Pierwszą rzeczą jaką powinniśmy zrobić to zajrzeć go Narzędzi dla webmasterów Google i skupić się na zakładce Diagnostyka > Błędy indeksowania. Jeżeli widzimy tam jakieś błędy indeksowania, powinniśmy zająć się nimi w pierwszej kolejności.

Kod odpowiedzi 404 (HTTP Status code) – najczęstszy błąd spotykany na stronach – oznacza, że pewne zasoby nie zostały odnalezione. Czasami jest to usunięta strona, czasami animacja SWF lub plik graficzny. Krótko mówiąc, robot sieciowy odnalazł na naszej stronie odnośnik do czegoś co nie istnieje. W zasadzie prawie każdy kod odpowiedzi poza 200 lub ewentualnie 301 oznacza, że coś jest nie tak ze stroną.

Kilka przyczyn błędnego indeksowania strony

Może to być jeden lub nawet kilka błędów, które powodują problemy z indeksowaniem strony , jednak sprawdzić należy wszystkie:

- Plik robots.txt – plik tekstowy umieszczony w folderze głównym strony internetowej. Jest swoistym drogowskazem i wskaźnikiem dla robotów sieciowych co mają robić, do czego maja dostęp a gdzie mają nie zaglądać. Najprostszy zapis to User-agent: * oraz Disallow: / (nie indeksuj niczego, nigdzie nie zaglądaj) lub Allow: / (indeksuj oraz zaglądaj wszystko i wszędzie).

- Plik .htaccess – niewidzialny plik znajdujący się w folderze WWW lub public_html. Źle skonfigurowany może zablokować dostęp do poszczególnych części strony, spowodować niekończące się przekierowania, które blokują dostęp robotów do strony lub poszczególnych jej części.

- Niski PageRank strony – ilość zaindeksowanych przez roboty sieciowe stron jest wprost proporcjonalna do jego wartości.

- Meta tagi – niektóre wartości meta tagu robots mogą blokować indeksowanie strony np. <meta name=”robots” content=”noindex, nofollow”>.

- Problemy z serwerem – jeżeli często występują problemy z połączeniem lub przekracza ono limit połączenia, uniemożliwia to robotowi sieciowemu dostać się do zasobów naszej strony.

- Parametry adresu URL – zbyt dużo parametrów w adresie URL (np. http://domena.pl/index.php?a=1&b=2&c=3…itd.). Roboty sieciowe to automaty a parametry zawarte w adresie URL projektowane są dla wygody i zrozumienia ich twórcy. Źle skonfigurowane i/lub błędnie używane potrafią sprawić, że robot pogubi się przy ich indeksowaniu. Google w swoich Narzędziach dla webmasterów udostępniło w zakładkę Konfiguracja witryny > Parametry w adresie URL, w niej możemy podpowiedzieć robotom, co oznaczają poszczególne parametry oraz które mają zostać zaindeksowane.

- Mapa strony – z jakiegoś powodu mogła zostać źle pobrana lub przy jej tworzeniu nastąpił błąd. Warto sprawdzić w narzędziach Google (Konfiguracja witryny > Mapy witryny), czy została poprawnie odnaleziona i odczytana przez robota sieciowego.

- Domena ze złą historią – rzadko, ale zdarza się, że rejestrujemy domenę, która była już wcześniej używana. Do tego nie cieszyła się uznaniem wśród wyszukiwarek lub nawet została przez nie wykluczona z indeksu. W takim wypadku należy wypełnić formularz z prośbą o ponowne rozpatrzenie zgłoszenia witryny.

- Małowartościowa strona – słabe indeksowanie może wynikać z faktu, że na naszej stronie umieszczamy treści pochodzące ze źródeł już znajdujących się w internecie (masowo powielamy czyjeś treści) lub zadbaliśmy o odnośniki do naszej witryny z małowartościowych stron ze słabą reputacją.

To tylko część najczęstszych błędów na naszej witrynie, które powodują brak lub niskie indeksowanie naszych podstron. Jednak zanim załamiemy ręce, warto je sprawdzić.

„Niski PageRank strony – ilość zaindeksowanych przez roboty sieciowe stron jest wprost proporcjonalna do jego wartości. ”

whaaaaaaaattttt? mógłbyś rozwinąć ? bo pierwsze słyszę 🙂

Rzeczywiście, źle sformułowany punkt – skrót myślowy. Dzięki za zwrócenie uwagi.

Nowe podstrony ze świeżą, unikalną treścią są chętnie indeksowane, lecz po jakimś czasie grozi im wyindeksowanie (nieaktualna treść, spadek popularności). Przed usunięciem strony a dokładnie podstrony z indeksu, może ją ochronić wysoki PR. A dokładniej, prowadzące do niej wartościowe linki, które nabijają PR. Mniej więcej o to chodzi w tym punkcie. Postaram się go przeredagować.

oczywiście „problemy z serwerem” to nie jest page speed (szybkość ładowania strony itd.) więc śmiało można powiedzieć że powinien być tam jeszcze jeden punkt:

– szybkość ładowania się stron serwisu

i dodam, z doświadczenia, że znacznie wpływa to na indeksowanie serwisu, a dobra optymalizacja kodu, cache itd. przy dużych serwisach jest jak magiczna różczka => wszystko zaczyna być indeksowane po poprawkach

pozdrawiam

Teraz poważne błędy indeksowania witryny lub nagły wzrost błędów indeksowania pojedynczych adresów URL doczekały się powiadomień w centrum wiadomości Narzędzi dla webmasterów: http://blog.performancemedia.pl/google/bledy-indeksowania-stron-nowe-alerty-w-narzedziach-dla-webmasterow