Jak nieskutecznie zablokować stronę dla Google?

Większość osób może się zastanawiać, po co w ogóle blokować dostęp do strony dla Google i innych wyszukiwarek oraz robotów sieciowych przeszukujących internet. Cóż, czasami istnieje taka potrzeba. Nie zawsze i nie wszystkim co umieszczamy na stronie chcemy się dzielić ze światem. Zdarza się, że pewnymi informacjami chcemy podzielić się tylko ze znajomymi. Jako, że Google zdominowała nasz rynek wyszukiwarek internetowych, głównie jej dotyczył mały test. Zacznijmy jednak od sposobów, jakie zalecane są przez Google, w powstrzymania go przed „zaglądaniem” tam, gdzie sobie tego nie życzymy i nie wyświetlaniem treści, których nie chcemy upubliczniać.

Robots.txt: Najprostszym sposobem jest umieszczenie w pliku robots.txt linijki zabraniającej Google zaglądanie do np. poszczególnych katalogów, czy plików. Robimy to wpisując do pliku Disallow: /katalog/ dla wszystkich podstron w katalogu lub Disallow: /katalog/plik.html, dla konkretnej podstrony.

Metatag (noindex): ten metatag zakazuje wyświetlania przez Google w wynikach wyszukiwania podstrony, w której kodzie się znajduje <meta name=”robots” content=”noindex „>.

Metatag (nofollow): wpisując w sekcje head strony <meta name=”robots” content=”nofollow „> a następnie, umieszczając link na tej stronie, mówimy Google, by nie podążało za znalezionymi na niej odnośnikami – teoretycznie.

Link w tekście: Musimy też wiedzieć, że Google odczytuje odnośniki umieszczone w treści tekstu na stronie, jednak traktuje je jako linki nofollow, czyli teoretycznie – Google nie podąża za nimi.

Pozycja strony jest ważna, jednak ważniejszy jest ruch jaki generuje. Sprawdź to na https://www.codum.pl// i napisz co o tym sądzisz!

TEST:

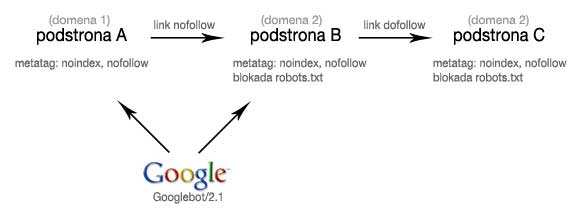

Na dobrze zaindeksowanej stronie (domena 1), na jednej z podstron (A) umieszczono odnośnik w postaci tekstu (j.w.). Podstrona w kodzie zawierała metatag noindex, nofollow. Odnośnik prowadził do podstrony B (domena 2), która również zawierała metatag noindex, nofollow. Dodatkowo dostęp do B i innych podstron w katalogu zablokowany był w pliku robots.txt. W Narzędziach Google widoczna była blokada z pliku robots.txt, a więc robot sieciowy wiedział o niej.

Kolejno, podstrona B linkowała zwykłym linkiem tekstowym do podstrony C (domena 2), zablokowanej w w/w sposób (plik robots.txt i metatag). Na podstronach B i C znajdowała się system monitorujący odwiedzających.

WYNIKI:

Oczywiście, nie tylko Google przeszukuje internet, a więc w rejestrze odwiedzin podstron B i C znajduje się wiele robotów sieciowych. Jednak między innymi i Googlebot się znalazł i to dwukrotnie:

66.249.71.162 | Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html)

Zaznaczyć muszę, że Google odwiedziło jedynie podstronę B, czyli tą, do której odnośnik umieszczony był na innej domenie (podstrona A). Jednak ani metatag „noindex, nofollow”, ani link odczytywany jako nofollow, ani też blokada disallow w pliku robots.txt, nie powstrzymały robota sieciowego przed wejściem na podstronę B. Nie zanotowano odwiedzin Google na podstronie C, a więc blokada wewnątrz blokowanego katalogu prawdopodobnie powstrzymała robota.

Co ciekawe, mimo, że podstrona A była odwiedzana przez Bing’a, nie wszedł on na podstronę B.

PODSUMOWANIE:

Na początek podsumowania wyników przytoczę cytaty z opisu pliku ROBOTS.TXT znajdujące się w Pomocy Google:

Nie można narzucić bezwarunkowego przestrzegania zapisów pliku robots.txt… – dotyczy to głownie mniej zaawansowanych lub wyspecjalizowanych wyszukiwarek.

Google nie będzie pobierać ani indeksować zawartości stron zablokowanych w pliku robots.txt, ale może indeksować te URL-e, jeśli zostaną znalezione na innych stronach w sieci. – i to jest kluczowy element całego testu. Jeżeli umieścimy odnośnik w jakiejkolwiek formie na innej stronie, podstrona, do której odsyła może pojawić się w wynikach wyszukiwania. Oznacza to, że blokada w pliku robots.txt działa, ale… tylko, gdy nie linkujemy do blokowanych podstron.

W przedstawionym teście, żaden z plików nie pojawił się w indeksie, a Google pobrało tylko ten, do którego prowadził odnośnik z zewnątrz. Wniosek jest taki, że nie ma możliwości w 100% zablokowania treści przed Google za pomocą metatagów, linków nofollow czy blokad w robots.txt. Dodatkowo, jak się okazuje, można zostać ukaranym za linki na stronach nieobecnych w indeksie Google (filtr z niezaindeksowanych stron).

Od kiedy link w tekście traktowany jest jako nofollow? Skąd takie informacje?

Od czasu, kiedy Google zaczęło je rozpoznawać w treści tekstu, a dokładniej w kodzie – np. adres url jako część tytułu strony i jak się okazuje w praktyce, Google podąża za nim, mimo, że traktowany jest jako nofollow.

(Nie mylić link w tekście != link tekstowy)

Tylko pytanie po co, coś takiego robić? Żeby nie było strony w Google i nie mieć tego ruchu?

Tak, Google biega za linkami no follow i też są one niezbędne do pozycjonowania, przy czym nie pozycjonują.

Po pierwsze – nie zawsze i wszystkie dane muszą być w wyszukiwarce oraz dostępne dla wszystkich. Są rzeczy, którymi chcemy podzielić się tylko ze znajomymi. Stąd sens istnienia zakazów/blokad np. w robots.txt. Po drugie, test miał na celu sprawdzić, czy Google przestrzega swoich zasad. W większości przypadków tak, jednak jak widać, są wyjątki i okazuje się, że to nie był odosobniony przypadek.

A co do podążania Google za linkami nofollow, miałem akurat na myśli inny przypadek Google+ generuje błędy w WMT